Het grote DIY NAS Topic |

|

| Al weer deeltje drie van "Het grote DIY RAID NAS" topic. Nog steeds blijken veel Tweakers geinteresseerd te zijn in het zelf maken van een NAS met RAID functionaliteit. Voordelen hiervan zijn de doorgaans hogere performance van een zelf gebouwd systeem t.o.v. een embedded oplossing en door het gebruik van een gangbaar OS is men flexibeler in de software die gebruikt wordt. Zo kan het NAS tevens eenvoudig ingezet worden als webserver, domain controller, gameserver, of welke toepassing dan ook die men op een regulier consumenten NAS niet aan de praat krijgt. Uit het afgelopen topic blijkt dat voor een DIY RAID NAS veelal gebruik gemaakt werd van *NIX besturingssystemen. Een reden hiervoor is dat zodra je aan complexere RAID levels gaat denken als RAID5 en RAID6, dat Windows hier qua software RAID geen fatsoenlijk performende oplossing aanbiedt, terwijl de software RAID van besturingssystemen als Solaris, Linux en FreeBSD vrij goed performed. In dit topic gaan we weer verder met het discussieren over de laatste nieuwtjes die door het een of ander gerelateerd zijn aan het zelf maken van een NAS, vraagstukken behandelen met betrekking tot het aanschaffen van een nieuw NAS of als je gewoon even wilt patsen met je zojuist aangeschafte NAS. Zorg in dat geval wel voor foto's Lees trouwens voordat je eventueel specifieke RAID vragen wilt gaan stellen in ieder geval de RAID FAQ en de RAID wikidoor, aangezien daar waarschijnlijk veel van je vragen al worden beantwoord. Over nu naar advies met betrekking tot het samenstellen van je NAS, uitgaande dat je met een schone lei begint. |

| Hardware: |

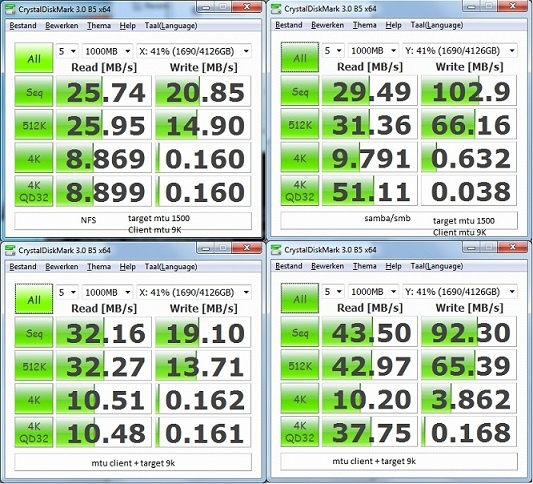

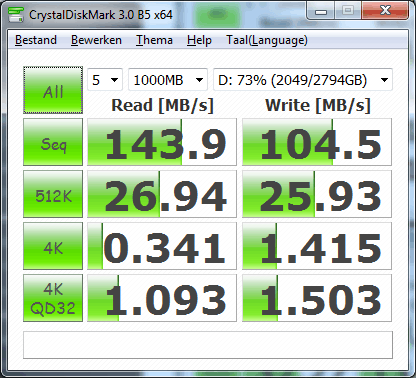

| Processor, moederbord en geheugen: De kern van je NAS. Hiermee bepaal je in feite al of je een energiezuinige-, een überperformance-, een spotgoedkope- of een guldenmiddenwegfileserver wilt hebben. Een NAS moet natuurlijk uiteindelijk data over het netwerk pompen. 100mbit trekken vrijwel alle courante CPU's tegenwoordig wel vol, maar wanneer je met gigabit aan de slag gaat, moet je toch wel wat meer cpu power in huis hebben. Een oude P3 of celeron die je eventueel nog hebt liggen zal hoogstwaarschijnlijk op gigabit niet veel sneller zijn dan op 100mbit, maar zal bovendien relatief niet erg zuinig zijn. Als je ouders de energierekening betalen en die het allemaal wel best vinden is dat natuurlijk geen probleem, maar voor de mensen die hun eigen rekening betalen is het wellicht aan te raden eens door te rekenen hoe lang het duurt eer je een nieuw, meer energiezuinig nas er al uit hebt. AMD heeft qua energieverbruik nog altijd een streepje voor op Intel. Mede dankzij de lage prijs is een systeem gebaseerd op een AMD platform ideaal voor een NAS. Aangezien Software RAID wat ruimte in het geheugen wel prettig vindt en de prijzen ervan tegenwoordig zo belachelijk laag zijn, is 1GB toch echt wel het minimum wat je zou moeten willen. SATA (RAID) Controllers: In de meeste gevallen zal software raid wel voldoen, zeker als je RAID0, 1 of zelfs 1+0 gaat draaien. RAID5 is echter een ander verhaal. Hierbij moet immers bij elke write pariteit worden berekend en weggeschreven. Dat resulteert in een lagere write-performace. Zeker als je de standaard onboard RAID5 implementatie van je moederbord of die van windows gaat gebruiken kan de performance bedroevend zijn (minder dan 15MB/sec writes zijn eerder regel dan uitzondering). Gelukkig bestaan er wel goede implementaties, bijvoorbeeld geom_raid5 voor FreeBSD, MDADM voor Linux en de voor het ZFS filesystem beschikbare "RAID-Z". Hardwarematige raid controllers zijn in de meeste gevallen voor een thuis NAS overkill, maar kunnen nuttig zijn in de volgende situaties. Je wilt RAID5 of 6 draaien en: • Je gebruikt Windows op je NAS (de softwarematige RAID5 alternatieven van windows lopen sterk achter op die van Linux en FreeBSD) • Je móet beslist Online Capacity Expansion of Online Raid Level Migration functionaliteit hebben. • Hoge IO concurrency (bijv. fileserver op een LAN-party waar veel mensen tegelijk leechen • Je hebt het geld ervoor en wilt een extra patsfactor aan je NAS toevoegen Als je tot de conclusie bent gekomen dat je inderdaad een hardwarematige raid controller nodig hebt én over voldoende budget beschikt, zijn bijvoorbeeld de controllers van het merk Areca aan te raden. Deze staan bekend om hun uitstekende performance, degelijkheid en goede support. Daarnaast zijn er natuurlijk voldoende andere aanbieders van raidcontrollers. Zorg in ieder geval dat je een koopt waarbij er een dedicated CPU op zit die de XOR berekeningen uitvoert. Anders wordt je main CPU alsnog lastig gevallen met XOR operaties waar die niet voor is geoptimaliseerd en is je prijs/performance ten opzichte van een goede software raid5 oplossing er veelal flink op achteruit gegaan Het kan natuurlijk ook zo zijn dat je te weinig SATA poorten hebt en software RAID wilt draaien. In dat geval kun je een gewone, simpele sata controller gebruiken. Let er hierbij wederom wel op dat de PCI-bus vrij snel vol zit. Als je dus nog een leeg PCI-e x1 slot hebt doe je er beter aan een PCI-Express SATA controller te kopen. Kast en voeding: Voor een thuisserver is een stille kast in combinatie met een efficiënte voeding meestal de beste oplossing. Bij de drivebays is het ook handig om te weten dat je elke 5.25" met een simpel en goedkope bracket kunt gebruiken voor een 3.5" harde schijf. Enkele merken kasten waarbij je eigenlijk altijd wel goed zit, zijn Antec, Chieftec en CoolerMaster die alle drie ook nog eens stock erg degelijke voedingen meeleveren; niet onbelangrijk voor een fileserver. Als je om wat voor reden dan ook een rackmount chassis wilt hebben, zou je eens kunnen kijken bij Chenbro. Die kasten zijn over het algemeen erg degelijk voor een relatief vriendelijke prijs. Als je toch op de energiezuinige tour bent kun je evengoed even kijken naar Mini-ITX oplossingen. Deze kastjes zijn doorgaans voorzien van een redelijk laag wattage voeding en in combinatie met een intel atom 'achtig' systeem kun je dan voor erg weinig watt toch een NASje maken. Een andere optie is om in zo'n kast een moederbord te stoppen waar je een normale (energiezuinige variant van een) desktop CPU op kunt plaatsen om op erg weinig cm3 relatief veel performance te krijgen. Check de Pricewatch voor de mogelijkheden. Een kastje wat zich voor dit doel erg leent is overigens de Chenbro ES34069. Deze kast heeft ruimte voor 4 hot-swappable harde schijven, 1 2.5" harde schijf, 1 slim-drive optical drive en een Mini-ITX moederbord. Helaas is de leverbaarheid van de kast niet om over naar huis te schrijven en gaat de kast in dat geval een substantieel deel van de complete kosten van het NAS innemen. Harde schijven: Tenslotte natuurlijk hetgeen waar je de bestanden opslaat: de harde schijven. Er is veel keus en het is maar net hoeveel ruimte je nodig hebt en hoeveel budget je hebt. Over de hoeveelheid schijven en de grootte ervan valt wat te zeggen. Het is handig om allereerst na te gaan hoeveel schijfruimte je in totaal wilt hebben en of je RAID wil gaan draaien. Als je bijvoorbeeld minimaal 4TB schijfruimte wilt hebben EN RAID5 wilt draaien, maar slechts plek hebt voor 4 harde schijven, kun je er voor kiezen 4 harde schijven van 2TB te nemen. Netto houd je dan 6TB over, terwijl als je zat ruimte hebt, misschien beter 1 of 1.5TB schijven kunt gebruiken omdat die een betere prijs/grootte verhouding bieden. Tenzij je natuurlijk het verbruik wilt beperken, want 2 harde schijven verbruiken nog altijd meer dan 1. |

| Software: |

| Operating System: Windows: Hoewel ik het doorgaans voor een DIY RAD NAS niet zou aanraden is Windows natuurlijk een optie. Het kan prettig zijn als je geen zin hebt om energie en moeite te steken in het 'leren' van een nieuw besturingssysteem; alles is lekker vertrouwd en het is meestal ook nog vrij stabiel te noemen. De RAID5 implementatie van Windows is echter niet zo snel als die van de op *nix gebaseerde varianten. Als je er verder geen problemen mee hebt dat je schrijfsnelheden erg laag zijn ten opzichte van *NIX alternatieven, is Windows een reëele optie. De server edities van Windows ondersteunen standaard RAID5, maar Windows XP niet. Gelukkig hebben we daar de RAID hack voor. FreeBSD: FreeBSD is een geavanceerd serverbesturingssysteem met unieke features. Zo kent FreeBSD natuurlijk software RAID met het GEOM-framework, maar het meest bekend onder NAS is FreeBSD vanwege zijn uitstekende ondersteuning voor ZFS. Zelfs met unieke features die andere OS niet hebben; zo kan FreeBSD direct van een RAID-Z pool booten zonder losse systeemdisk nodig te hebben. FreeNAS: FreeNAS is een OS gebaseerd op FreeBSD, specifiek voor het draaien van een NAS. Het is lichtgewicht en simpel te configureren via de webinterface. Vrijwel alle standaardfeatures die je van een NAS verwacht zitten erin, inclusief ondersteuning voor ZFS. Als je dus een OS zoekt waarbij je zo weinig mogelijk zelf hoeft te tweaken en die een kleine footprint heeft (het past op een 32MB CF kaart), kan dit een goede optie zijn. NAS4Free: NAS4Free is een doorontwikkeling van de FreeNAS 7 series web-interface, maar dan draaiende onder een moderne FreeBSD 9 motorkap. Vrijwel alle standaardfeatures die je van een NAS verwacht zitten er in en biedt RAID5 ondersteuning via een oudere (maar stabiele) versie van geom_raid5, maar wel met minder RAM genoeg neemt dan ZFS wat nutuurlijk ook wordt ondersteund. Als je dus een OS zoekt waarbij je zo weinig mogelijk zelf hoeft te tweaken en die een kleine footprint heeft (het past op een 128MB CF kaart), kan dit een goede optie zijn.. ZFSguru ZFSguru is zoals de naam doet vermoeden een NAS-distributie die zich volledig richt op ZFS en van de grond is opgebouwd met een interface die velen prijzen vanwege zijn helderheid en duidelijke opbouw. Dit project is van alle opties het minst doorontwikkeld. Wel zijn er add-on services beschikbaar die de functionaliteit uitbreiden met bijvoorbeeld SABnzbd+, Transmission of VirtualBox. In tegenstelling tot FreeNAS en NAS4Free kun je ZFSguru wel makkelijk uitbreiden; het is namelijk een volledige FreeBSD distributie onder de motorkap zonder zaken wegbezuinigd. Linux: Je DIY RAID NAS kun je prima baseren op Linux. MDADM biedt goede prestaties en is erg stabiel gebleken. De community is bovendien erg groot en er is daardoor veel informatie beschikbaar. Op http://linux-raid.osdl.org staat een mooie beschrijving over raid en dan met name de toepassing ervan op een linux machine. Welke distributie je wilt gebruiken is natuurlijk helemaal aan jou. Als je nog niet met een distro bekend bent, kijk dan even in Het grote welk OS (bijvoorbeeld linux distro) topic deel 7. Hieronder een aantal linux distributies die speciaal voor NASses ontwikkeld zijn: • Openfiler • SME Server OpenSolaris: Dit OS biedt out-of-the-box support voor ZFS, een erg vooruitstrevend filesystem. Echter zijn er in het vorige topic niet echt veel personen gebleken die hier gebruik van maakten, maar dat er wel interesse in is. Mocht iemand zin hebben hier een stukje over te schrijven: DM me dat even |

| Links: |

• Linux software RAID optimalisaties • Installatie van ZFS onder FreeBSD (experimenteel!) |

[ Voor 8% gewijzigd door Verwijderd op 04-08-2012 13:36 ]

:strip_icc():strip_exif()/u/28893/hell.jpg?f=community)

/u/1176/crop635f8931b2b68_cropped.png?f=community)

/u/71954/crop5daf689d5ff80.png?f=community)

/u/85846/notepad4_resize.png?f=community)

:strip_exif()/u/33876/crop5db309f39f3f0_cropped.gif?f=community)

:strip_exif()/u/8402/Untitled-2.gif?f=community)

:strip_exif()/u/96401/konijntjebovennognogkleiner.gif?f=community)

:strip_icc():strip_exif()/u/139376/27e.jpg?f=community)

:strip_exif()/u/264081/crop56d6d27c03d80_cropped.gif?f=community)

/u/24671/crop55d1ea05b175b.png?f=community)

:strip_exif()/u/270062/15726748.gif?f=community)

/u/231803/ramdisk2.png?f=community)

:strip_icc():strip_exif()/u/79988/XD_small.jpg?f=community)

/u/85941/crop61dd9b39bb021_cropped.png?f=community)

:strip_exif()/u/16970/crop57cd1ef1eb0d0.gif?f=community)

:strip_icc():strip_exif()/u/10414/crop5817c0657774d_cropped.jpeg?f=community)

/u/19931/crop564ae8061f7c3.png?f=community)

:strip_exif()/u/66072/dj.gif?f=community)

/u/266773/mae.png?f=community)

:strip_icc():strip_exif()/u/46703/LOGO1.jpg?f=community)

:strip_exif()/u/294322/64-floyd.gif?f=community)