Recent zijn we voor een blade enclosure (HP c7000) overgegaan van 1 GBit Cisco-switches interconnects naar HP Flex-10 modules. Omdat die dingen toch iets anders in elkaar zitten dan ik had gedacht weet ik niet zeker of ik wel alles goed heb ikgesteld, en dat is waarom ik dit topic open

Eerst de topologie: We hebben een VSS-core (2x Cisco 6509 die samen één zijn) met port channels naar 2 stuks Cisco Nexus 5548 in vPC (die twee lijken voor client devices samen één maar intern doen ze maar alsof).

Van de Nexus-laag lopen er port channels (LACP, één Po per interconnect) naar de Flex-10-modules. Intern knopen de Flex-10-modules zichzelf ook aan elkaar met interne uplinks. Samen vormen ze één Virtual Connect-domein. Alle fysieke poorten en port channels staan op de Cisco's op switchport mode trunk.

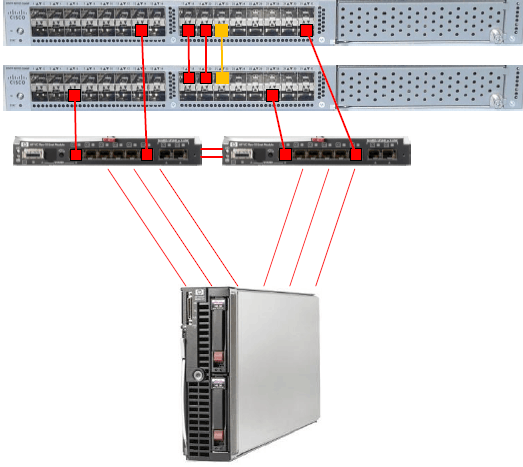

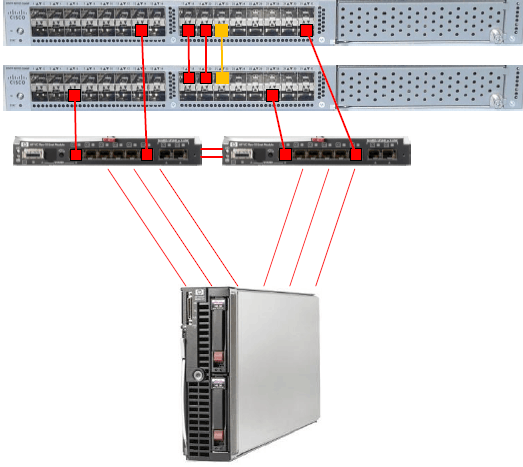

Plaatje (poorten zijn ter indicatie, maakt als het goed is voor de principes niet uit):

Op iedere Flex-10-module is een Shared Uplink Set aangemaakt met alleen de uplinks van die module. Op die manier zijn beide poorten active. Maak ik er één grote SUS van dan staat de helft van de poorten standby ipv active. Ik heb dus UplinkSet_Links en UplinkSet_Rechts.

Ik wil/kan geen poorten 'opofferen' aan VLAN Tunneling dus ik zit helaas vast aan Mapped Mode.

Omdat ik 2 uplinkSets heb, moet ik ieder VLAN ook 2x definieren:

Network_10_Links

Network_10_Rechts

Network_11_Links

Network_11_Rechts

...

Network_99_Links

Network_99_Rechts

Tot slot maak ik 6 virtuele netwerkadapters aan in het server profile, 3 op 'links' en 3 op 'rechts, met daaraan de volgende netwerken toegekend:

vmnic0 - Netwerk_10_Links

vmnic1 - Network_10_Rechts

vmnic2 - Netwerk_11_Links

vmnic3 - Network_11_Rechts

vmnic4 - Alle 'links'-netwerken behalve 10 en 11

vmnic5 - Alle 'rechts'-netwerken behalve 10 en 11

In VMware hang ik vmnic0 en vmnic1 aan de vSwitch met de VMkernel voor management, vmnic2 en vmnic3 hang ik aan de vSwitch met de VMkernel voor vMotion en vmnic4 en vmnic5 hang ik aan de dvSwitch met de server-VLANs.

Uitgangspunt voor dit geheel was HP Virtual Connect FlexFabric Module and VMware vSphere 5 maar in ons geval betreft het Flex-10 ipv FlexFabric en vSphere 4.1 ipv 5

Mijn vragen hierbij zijn:

- Klopt dit een beetje?

- Klopt het dat een Server Profile maar aan exact één server gekoppeld kan zijn en ik bij het toevoegen van een VLAN dit dus op 2 (SUS) + 2x (aantal VMware hosts) plekken moet doen in de VCM?

- Waarom zie ik 0,4% discards op de individuele poorten van de SUS? Counters op de Nexus laten minder dan 3 error packets zien terwijl de discards in de miljoenen lopen.

Eerst de topologie: We hebben een VSS-core (2x Cisco 6509 die samen één zijn) met port channels naar 2 stuks Cisco Nexus 5548 in vPC (die twee lijken voor client devices samen één maar intern doen ze maar alsof).

Van de Nexus-laag lopen er port channels (LACP, één Po per interconnect) naar de Flex-10-modules. Intern knopen de Flex-10-modules zichzelf ook aan elkaar met interne uplinks. Samen vormen ze één Virtual Connect-domein. Alle fysieke poorten en port channels staan op de Cisco's op switchport mode trunk.

Plaatje (poorten zijn ter indicatie, maakt als het goed is voor de principes niet uit):

Op iedere Flex-10-module is een Shared Uplink Set aangemaakt met alleen de uplinks van die module. Op die manier zijn beide poorten active. Maak ik er één grote SUS van dan staat de helft van de poorten standby ipv active. Ik heb dus UplinkSet_Links en UplinkSet_Rechts.

Ik wil/kan geen poorten 'opofferen' aan VLAN Tunneling dus ik zit helaas vast aan Mapped Mode.

Omdat ik 2 uplinkSets heb, moet ik ieder VLAN ook 2x definieren:

Network_10_Links

Network_10_Rechts

Network_11_Links

Network_11_Rechts

...

Network_99_Links

Network_99_Rechts

Tot slot maak ik 6 virtuele netwerkadapters aan in het server profile, 3 op 'links' en 3 op 'rechts, met daaraan de volgende netwerken toegekend:

vmnic0 - Netwerk_10_Links

vmnic1 - Network_10_Rechts

vmnic2 - Netwerk_11_Links

vmnic3 - Network_11_Rechts

vmnic4 - Alle 'links'-netwerken behalve 10 en 11

vmnic5 - Alle 'rechts'-netwerken behalve 10 en 11

In VMware hang ik vmnic0 en vmnic1 aan de vSwitch met de VMkernel voor management, vmnic2 en vmnic3 hang ik aan de vSwitch met de VMkernel voor vMotion en vmnic4 en vmnic5 hang ik aan de dvSwitch met de server-VLANs.

Uitgangspunt voor dit geheel was HP Virtual Connect FlexFabric Module and VMware vSphere 5 maar in ons geval betreft het Flex-10 ipv FlexFabric en vSphere 4.1 ipv 5

Mijn vragen hierbij zijn:

- Klopt dit een beetje?

- Klopt het dat een Server Profile maar aan exact één server gekoppeld kan zijn en ik bij het toevoegen van een VLAN dit dus op 2 (SUS) + 2x (aantal VMware hosts) plekken moet doen in de VCM?

- Waarom zie ik 0,4% discards op de individuele poorten van de SUS? Counters op de Nexus laten minder dan 3 error packets zien terwijl de discards in de miljoenen lopen.

[ Voor 4% gewijzigd door Paul op 19-06-2013 16:44 ]

"Your life is yours alone. Rise up and live it." - Richard Rahl

Rhàshan - Aditu Sunlock

/u/11437/wandcontactdoos.png?f=community)

:strip_icc():strip_exif()/u/39286/crop59ec5b33730d2_cropped.jpeg?f=community)

:strip_icc():strip_exif()/u/20194/baron2.jpg?f=community)

/u/31090/bla.png?f=community)

:strip_exif()/u/16622/121823.gif?f=community)